文章目录

视频理解研究进展

相比图像,视频多了一维时序信息。如何利用好视频中的时序信息是研究这类方法的关键。视频理解可以用于多个领域,例如在智能安防领域中可以取代人工来对监控视频进行分析。本文简要回顾视频理解方面的近期研究进展,并对未来可能的研究方向作一展望。

<1> 常用数据集

视频分类主要有两种数据集,剪辑过 (trimmed) 的视频和未经剪辑的视频。剪辑的视频中包含一段明确的动作,时间较短标记唯一,而未剪辑的视频还包含了很多无用信息。如果直接对未剪辑的视频进行处理是未来的一大研究方向。

H. Kuehne, et al. HMDB: A large video database for human motion recognition. In ICCV, pages 2556-2563, 2011.

(1) HMDB-51 :51 类、6,766 剪辑视频、每个视频不超过 10 秒、分辨率 320 240、共 2 GB。视频源于 YouTube 和谷歌视频,内容包括人面部、肢体、和物体交互的动作这几大类。

K. Soomro, et al. UCF101: A dataset of 101 human action classes from videos in the wild. CoRR, abs/1212.0402, 2012.

(2) UCF-101 :101 类、13,320 视频剪辑、每个视频不超过 10 秒、共 27 小时、分辨率 320 240、共 6.5 GB。视频源于 YouTube,内容包含化妆刷牙、爬行、理发、弹奏乐器、体育运动五大类。每类动作由 25 个人做动作,每人做 4-7 组。

A. Karpathy, G. Toderici, S. Shetty, T. Leung, R. Sukthankar, and F.-F. Li. Large-scale video classification with convolutional neural networks. In CVPR, pages 1725-1732, 2014.

(3) Sports-1M :487 类、1,100,000 视频(70% 训练、20% 验证、10% 测试)。内容包含各种体育运动。

G. A. Sigurdsson, et al. Hollywood in homes: Crowdsourcing data collection for activity understanding. In ECCV, pages 510-526, 2016.

(4) Charades :157 类、9,848 未剪辑视频(7,985 训练、1,863 测试)、每个视频大约 30 秒。每个视频有多个标记,以及每个动作的开始和结束时间。

B. G. F. C. Heilbron, V. Escorcia, B. Ghanem, J. C. Niebles. ActivityNet: A large-scale video benchmark for human activity understanding. In CVPR, pages 961-970, 2015.

(5) ActivityNet (v1.3) :200 类、19,994 未剪辑视频(10,024 训练,4,926 验证,5,044 测试)、共 648 小时。内容包括饮食、运动、家庭活动等。

W. Kay, J. Carreira, K. Simonyan, B. Zhang, C. Hillier, S. Vijayanarasimhan, F. Viola, T. Green, T. Back, P. Natsev, M. Suleyman, and A. Zisserman. The Kinetics human action video dataset. CoRR, abs/1705.06950, 2017.

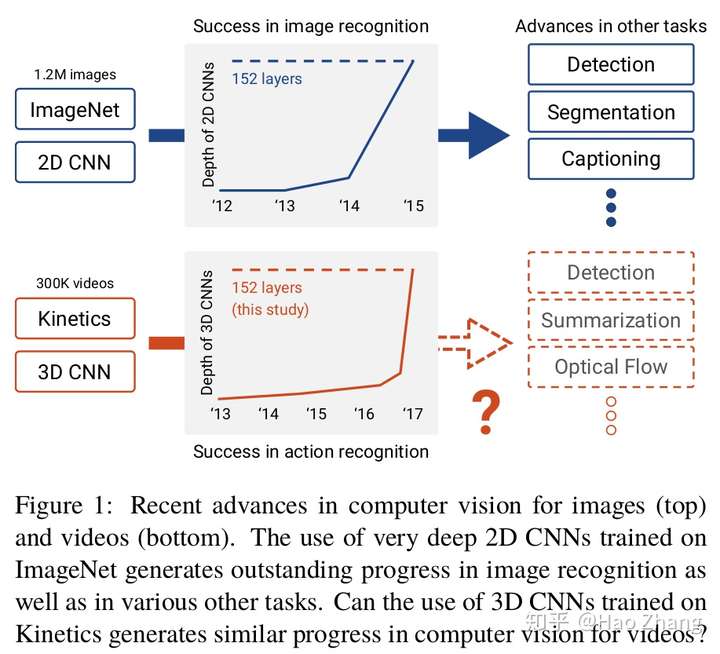

(6) Kinetics :400 类、246k 训练视频、20k 验证视频、每个视频大约 10 秒。视频源于 YouTube。Kinetics 是一个大规模数据集,其在视频理解中的作用有些类似于 ImageNet 在图像识别中的作用,有些工作用 Kinetics 预训练模型迁移到其他视频数据集。

S. Abu-El-Haija, N. Kothari, J. Lee, P. Natsev, G. Toderici, B. Varadarajan, and S. Vijayanarasimhan. YouTube-8M: A large-scale video classification benchmark. CoRR, abs/1609.08675, 2016.

(7) YouTube-8M :4716 类、7M 视频、共 450,000 小时。不论是下载还是训练都很困难。

R. Goyal, S. E. Kahou, V. Michalski, J. Materzynska, S. Westphal, H. Kim, V. Haenel, I. Fründ, P. Yianilos, M. Mueller-Freitag, F. Hoppe, C. Thurau, I. Bax, and R. Memisevic. The “Something Something” video database for learning and evaluating visual common sense. In ICCV, pages 5843-5851, 2017.

(8) Something-something :174 类、108,000 视频、每个视频 2 到 6 秒。和 Kinetics 不同,Something-something 数据集需要更加细粒度、更加底层交互动作的区分,例如 “从左向右推” 和 “从右向左推”。

此外,Video Dataset Overview 对常用数据集进行了总结。

G. A. Sigurdsson, O. Russakovsky, and A. Gupta. What actions are needed for understanding human actions in videos? In ICCV, pages 2156-2165, 2017.

相比图像分类,视频的类别 / 动作数目要少很多,而且常常有一定歧义,例如 take 和 put 要和后面名词结合才会有具体含义 (如 take medication, take shoes, take off shoes)。Sigurdsson 等人发现人类对这些动词也容易感到混淆。另外,视频中动作开始和结束的时间也不够明确。

<2> 经典方法

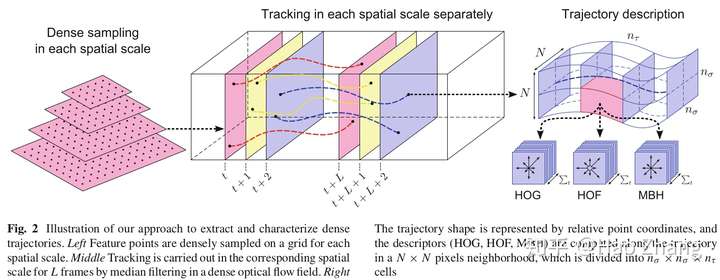

H. Wang, et al. Dense trajectories and motion boundary descriptors for action recognition. IJCV’13.

H. Wang and C. Schmid. Action recognition with improved trajectories. ICCV’13.

Wang 等人提出 DT 和 iDT 方法。DT 利用光流得到视频中的运动轨迹,再沿着轨迹提取特征。iDT 对相机运动进行了补偿,同时由于人的运动比较显著,iDT 用额外的检测器检测人,以去除人对相邻帧之间投影矩阵估计的影响。这是深度学习方法成熟之前效果最好的经典方法,该方法的弊端是特征维度高 (特征比原始视频还要大)、速度慢。实践中,早期的深度学习方法在和 iDT 结合之后仍能取得一定的效果提升,现在深度学习方法的性能已较 iDT 有大幅提升,因此 iDT 渐渐淡出视线。

(1)逐帧处理融合

这类方法把视频看作一系列图像的集合,每帧图像单独提取特征,再融合它们的深度特征。

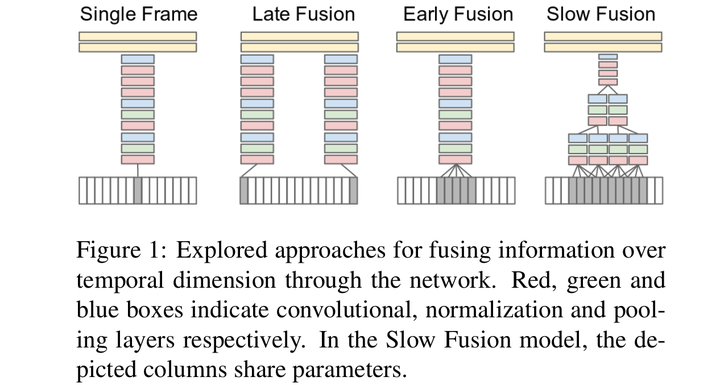

A. Karpathy, et al. Large-scale video classification with convolutional neural networks. CVPR’14.

Karpathy 等人把视频划分成很多固定长度的片段 (clip),并设计了多种融合方法。

- Single frame. 逐帧单独前馈网络。

- Late fusion. 两帧相距 15 帧的图像分别前馈网络,并融合它们的深度卷积特征。

- Early fusion. 连续 10 帧图像前馈网络,因此网络第一层的卷积核由 11×11×3 变为 11×11×3×10。Early fusion 的思路最早由 Le 等人提出。

Le, et al. Learning hierarchical invariant spatio-temporal features for action recognition with independent subspace analysis. CVPR’11.

- Slow fusion. 即使用 3D 卷积。连续 10 帧图像前馈网络,第一层卷积核时间方向大小为 4,第二、三层卷积核时间方向大小为 2。

此外,为了加速训练,由于目标通常位于图像中心,Karpathy 等人使用了一个两分支网络:一个分支输入空间大小下采样减半的图像,另一个分支输入原图中心裁剪后的图像。这样,总体的输入图像维数只有原图的一半。这两个分支的深度卷积特征拼接 (concatenate) 起来给全连接层进行分类。

实验发现,3D 卷积的融合效果最好,而不考虑运动信息的 single frame 策略已经是十分强的 baseline。Early fusion 策略效果最差的原因可能是直接从输入图像上捕获运动信息难度太大。

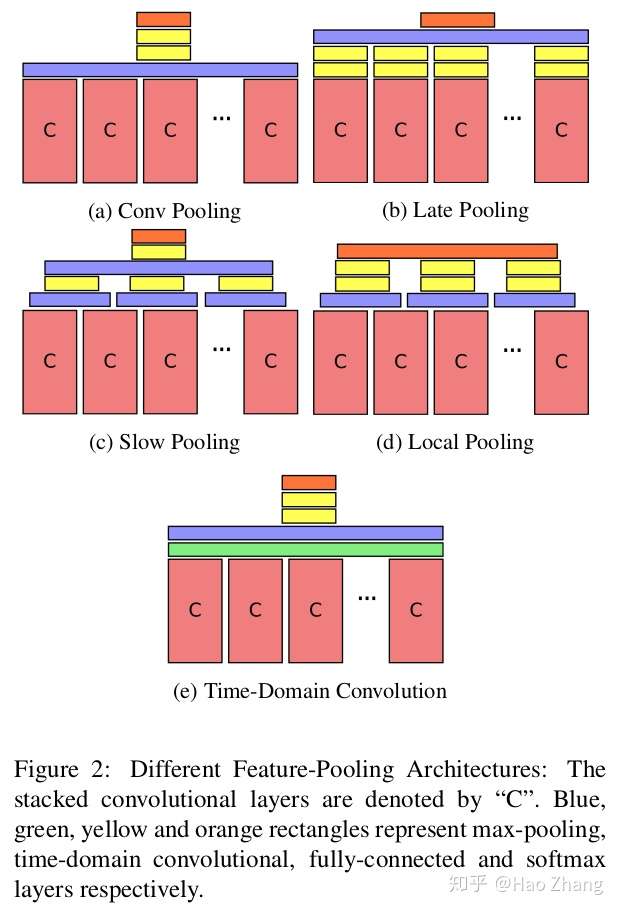

J. Y.-H. Ng, et al. Beyond short snippets: Deep networks for video classification. CVPR’15.

Ng 等人先提取每一帧的深度卷积特征,再设计特征融合方法得到最终输出。其中,紫色代表沿时间方向进行最大汇合 (max-pooling),黄色代表全连接层,绿色代表 3310,stride 5 的 3D 卷积,红色代表 softmax 输出。相比 Karpathy 等人,Ng 等人的输入视频片段的长度更长 (每秒采样 1 帧,一个片段由 120 帧构成),包含了更多的时序信息。实践中发现 (a) 的效果最好。

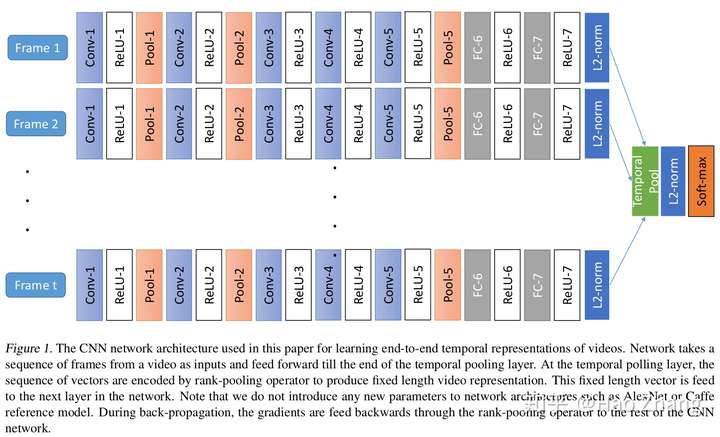

B. Fernando and S. Gould. Learning end-to-end video classification with rank-pooling. ICML’16.

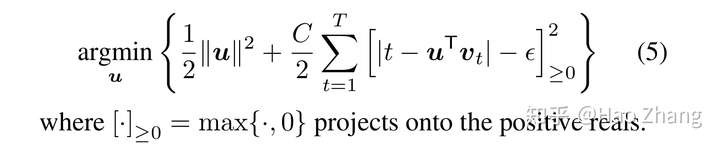

在得到每帧图像的深度卷积特征 之后,Fernando 和 Gould 通过解如下的优化问题来对特征进行排序汇合 (rank-pooling)。其动机是靠前的帧

要小一些,而靠后的帧大一些。

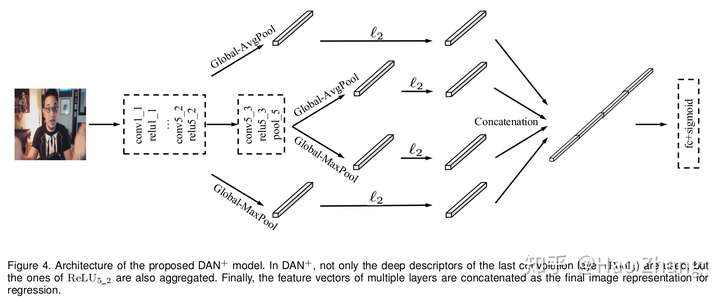

X.-S. Wei, et al. Deep bimodal regression of apparent personality traits from short video sequences. TAC’17.

由于相邻帧信息冗余度很高,Wei 等人从视频 (450 帧) 中采样 100 帧,每帧交由 DAN 分别进行预测。在得到 relu5-2/pool5 深度特征之后,DAN 将其全局最大 / 平均汇合以得到深度特征。

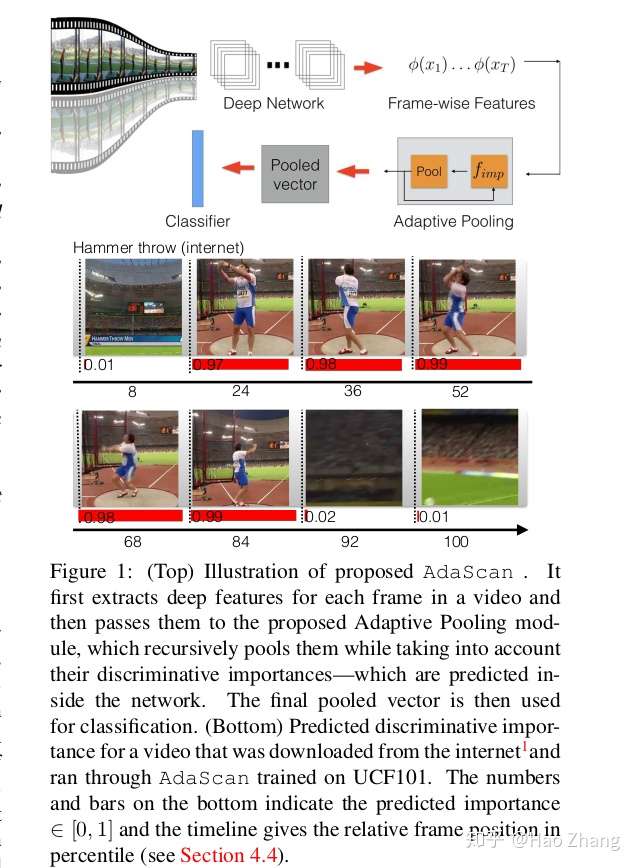

A. Kar, et al. AdaScan: Adaptive scan pooling in deep convolutional neural networks for human action recognition in videos. CVPR’17.

由于不同帧的重要性不同,Kar 等人提出 AdaScan 汇合方法。其逐帧提取特征,之后判断不同帧的重要程度,并据此进行特征汇合。

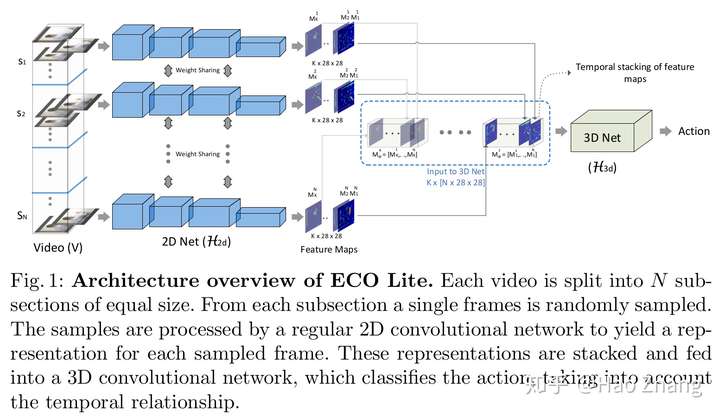

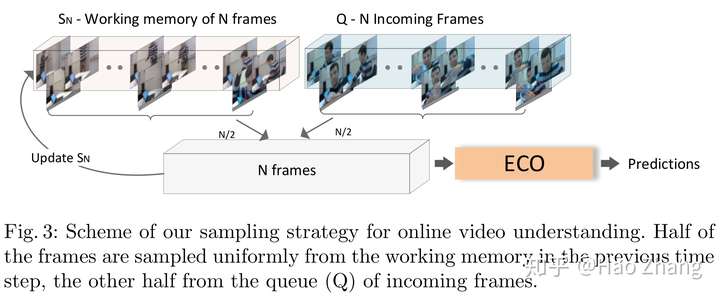

M. Zolfaghari, et al. ECO: Efficient Convolutional network for Online video understanding. arXiv:1804.09066.

Zolfaghari 等人提出 ECO。由于相邻帧有信息冗余,ECO 从视频中采样若干帧,每帧单独用 2D 卷积提取特征,之后沿时间方向拼接特征,再用 3D 卷积捕获它们的时序关系。ECO 和 state-of-the-art 方法性能相似,但速度上快了 10-80 倍。在测试时,为了捕获长距离依赖,输入视频片段由已看过的和未看过的视频中采样得到。

(2)ConvLSTM

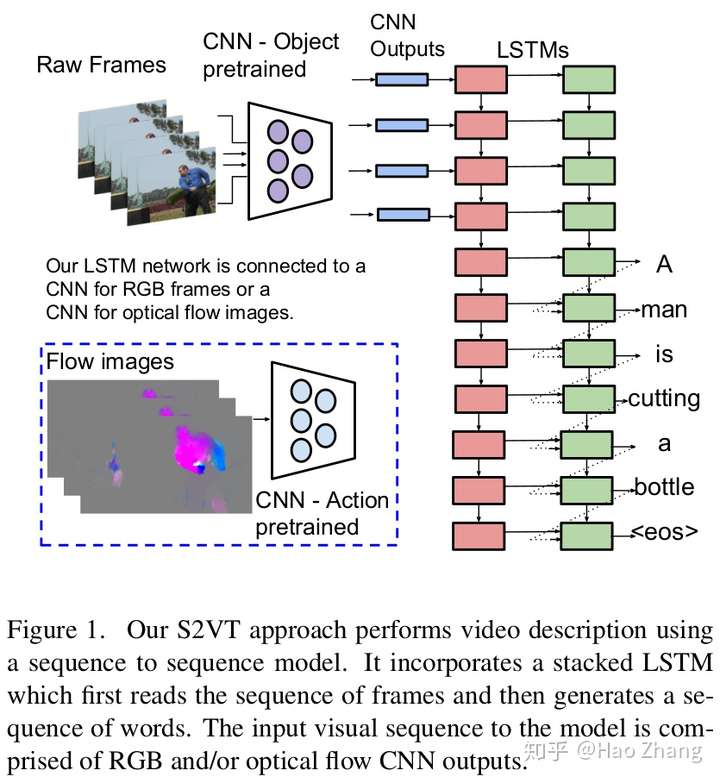

这类方法是用 CNN 提取每帧图像的特征,之后用 LSTM 挖掘它们之间的时序关系。

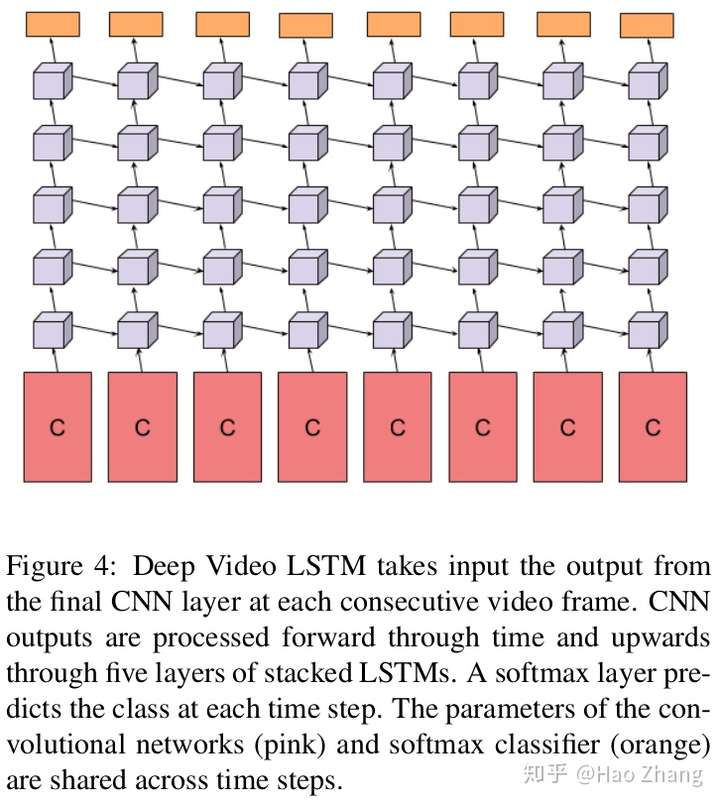

J. Y.-H. Ng, et al. Beyond short snippets: Deep networks for video classification. CVPR’15.

J. Donahue, et al. Long-term recurrent convolutional networks for visual recognition and description. CVPR’15.

Ng 等人在深度特征上,用 5 层隐层结点数 512 的 LSTM 来提取深度特征,每个时刻都进行输出。训练时,一个片段从第 1 帧到最后一帧输出层获得的梯度分别乘以 0.0-1.0 的权重,用以强调后面帧的重要性。测试时,计算这些帧输出的加权和。Donahue 等人也提出了类似的工作。此外,Ng 等人和 Donahue 等人还利用了光流输入。把 x、y 两个方向的光流缩放到 [0, 255] 作为光流图像前两个通道,把光流的大小作为第三个通道。

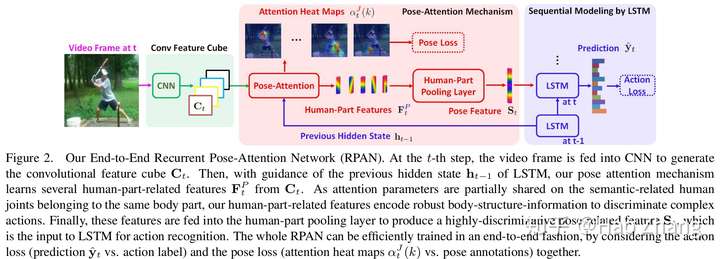

W. Du, et al. RPAN: An end-to-end recurrent pose-attention network for action recognition in videos. ICCV’17.

Du 等人利用人体姿态估计辅助动作识别。

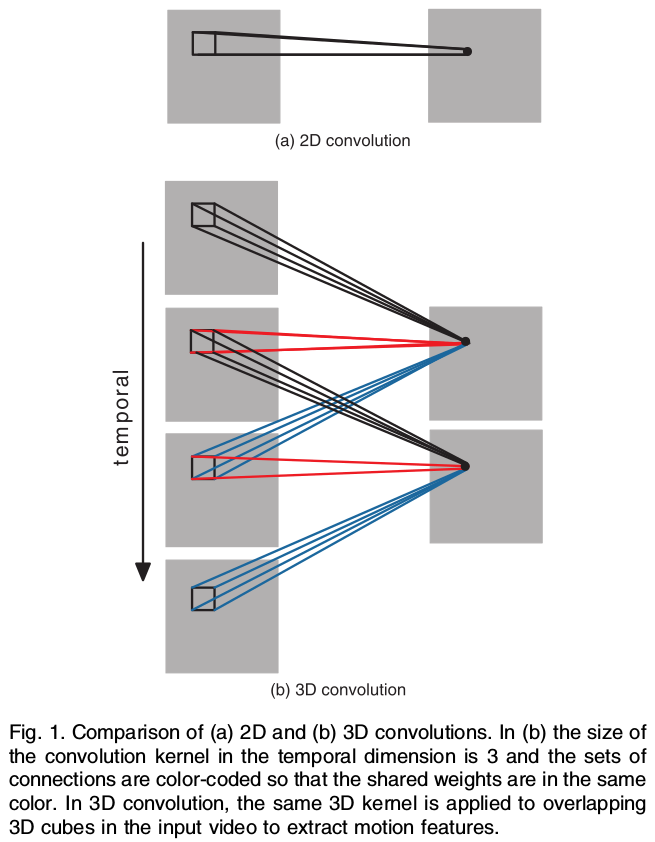

(3)3D 卷积

把视频划分成很多固定长度的片段 (clip),相比 2D 卷积,3D 卷积可以提取连续帧之间的运动信息。

在视频动作识别中最早提出 3D 卷积的是

M. Baccouche, et al. Sequential deep learning for human action recognition. HBU Workshop’11.

S. Ji, et al. 3D convolutional neural networks for human action recognition. TPAMI’13.

Baccouche 等人使用第一层卷积核时间方向大小为 5。Ji 等人使用第一、二层卷积核时间方向大小为 3,第三层卷积时由于时间维度大小很小,所以采用 2D 卷积。

此外,为使网络获得更多先验信息,Ji 等人使用了两个技巧:(1). 同时使用原始图像、图像梯度、和相邻帧光流作为输入。(2). 让网络额外地学习运动信息接近手工运动特征。

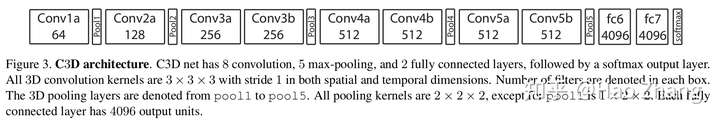

D. Tran, et al. Learning spatio-temporal features with 3D convolutional networks. ICCV’15.

Tran 等人提出 C3D,其将 3×3 卷积扩展到 3×3×3 卷积,2×2 汇合扩展到 2×2×2 汇合。输入片段 16 帧。实验中发现,时域方向卷积核大小为 3 效果最好。相比 2D CNN,3D CNN 的参数量很大,训练变得更困难,且需要更多的训练数据。相比其他类型的方法,C3D 一次处理多帧,所以计算效率很高。

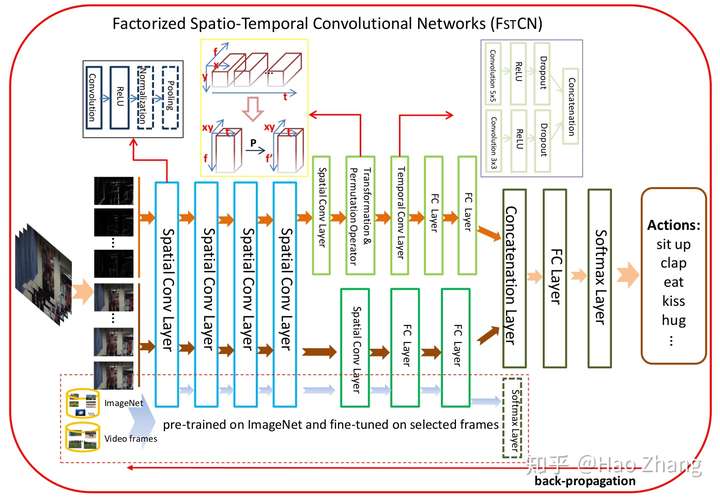

L. Sun, et al. Human action recognition using factorized spatio-temporal convolutional networks. ICCV’15.

Sun 等人把 3D 卷积分解为空间方向 2D 卷积和时间方向 1D 卷积。

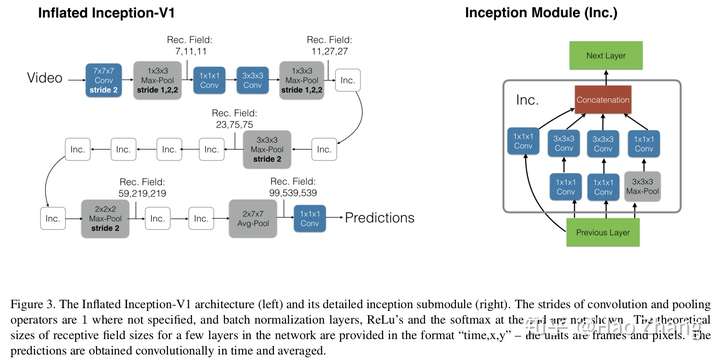

J. Carreira and A. Zisserman. Quo vadis, action recognition? A new model and the Kinetics dataset. CVPR’17.

Carreira 和 Zisserman 提出 I3D,把 two-stream 结构中的 2D 卷积扩展为 3D 卷积。由于时间维度不能缩减过快,前两个汇合层的卷积核大小是 1×2×2,最后的汇合层的卷积核大小是 277。和之前文章不同的是,two-tream 的两个分支是单独训练的,测试时融合它们的预测结果。

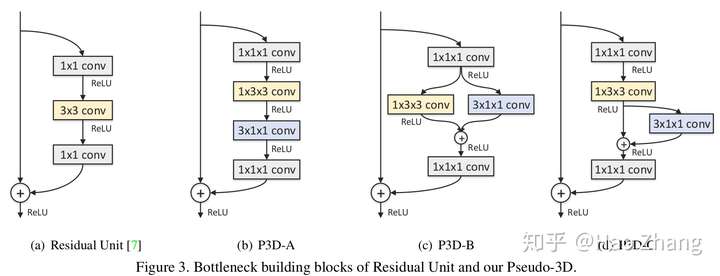

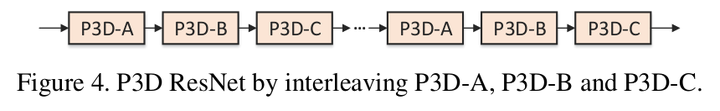

Z. Qiu, et al. Learning spatio-temporal representation with pseudo-3D residual networks. ICCV’17.

Qiu 等人提出 P3D,用一个 1×3×3 的空间方向卷积和一个 3×1×1 的时间方向卷积近似原 3×3×3 卷积。通过组合三种不同的模块结构,进而得到 P3D ResNet。P3D ResNet 在参数数量、运行速度等方面对 C3D 作出了优化。

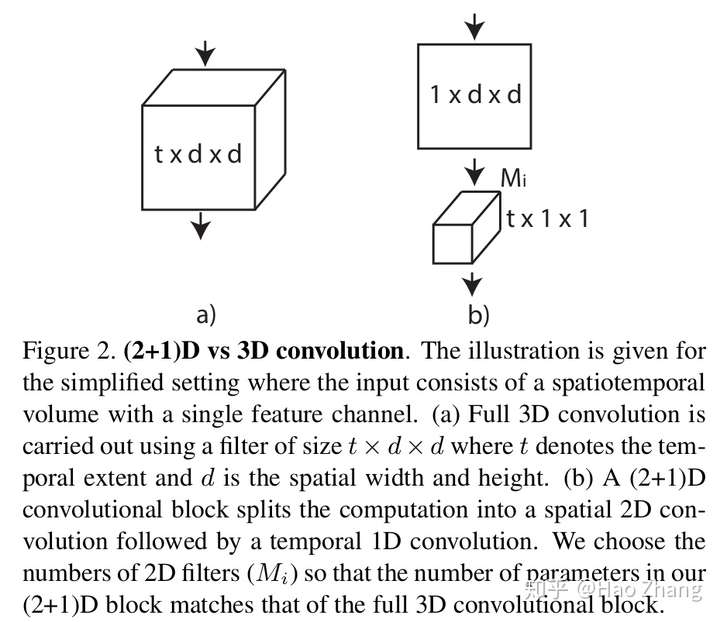

D. Tran, et al. A closer look at spatio-temporal convolutions for action recognition. CVPR’18.

Tran 等人提出 ResNet (2+1) D,把一个 3D 卷积分解成为一个 2D 卷积空间卷积和一个 1D 时间卷积,注意这里的参数量和原 3D 卷积相同。相比 P3D 有三种形式,(2+1) D 和 P3D-A 最接近。

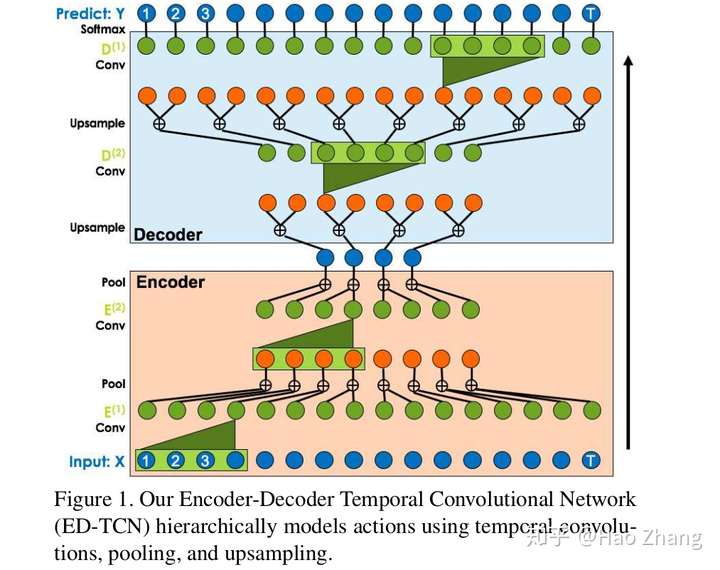

C. Lea, et al. Temporal convolutional networks for action segmentation and detection. CVPR’17.

受 WaveNet 启发,Lea 等人提出一个编码 - 解码网络,并使用空洞卷积和短路连接,以捕获长距离依赖。实验中发现,这种结构效果优于 RNN。

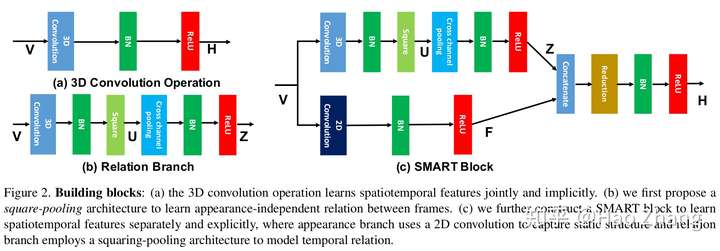

L. Wang, et al. Appearance-and-relation networks for video classfication. CVPR’18.

Wang 等人希望利用 3D 卷积显式地学习类似 two-stream 的结构。Wang 等人通过不同帧之间的乘性关系度量不同帧之间的关系。

K. Hara, et al. Can spatio-temporal 3D CNNs retrace the history of 2D CNNs and ImageNet? CVPR’18.

ImageNet 预训练的 2D CNN 在多种视觉任务上取得了成功,Hara 等人尝试了多种 Kinetics 预训练的 3D CNN 模型迁移到其他数据集上的表现。发现直接用 3D ResNet-18 训练 UCF-101,HMDB-51,和 ActivityNet 会过拟合,而 Kinetics 不会。利用 Kinetics 预训练模型会提升其他数据集的性能。

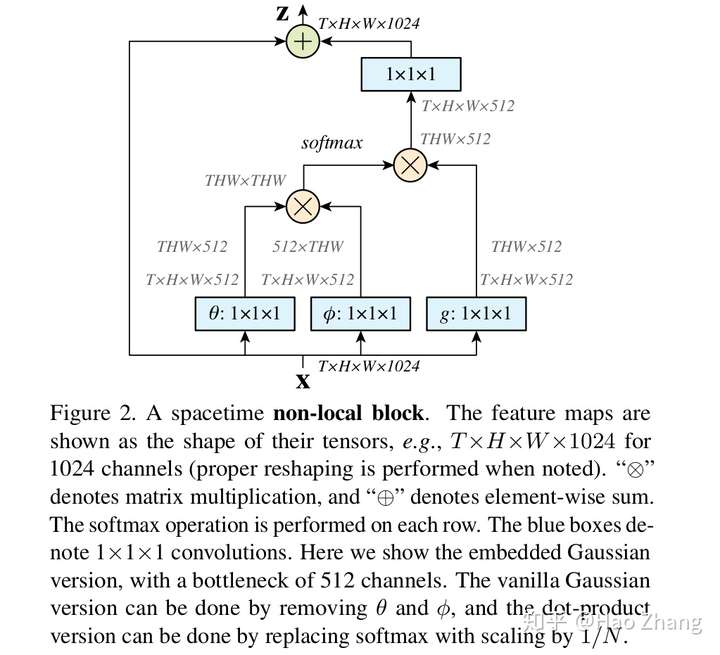

X. Wang, et al. Non-local neural networks. CVPR’18.

可以看作是 3D 卷积的一个扩展。3D 卷积的感受野是有限区域,而 non-local 旨在解决长距离依赖问题。Non-local 的响应是所有空间和时间位置特征的加权平均

其中,

用于度量相似性

计算响应

用于归一化

当 ,non-local 操作退化为全连接层

当 ,non-local 操作

退化为 self-attention。

实验中发现 non-local block 加在底层比加在高层效果要好,加多个 non-local blocks 会有效果提升但不是很明显。

这类方法的弊端是只能考虑比较短的时间片段的运动信息,参数量?

(4)Two-stream

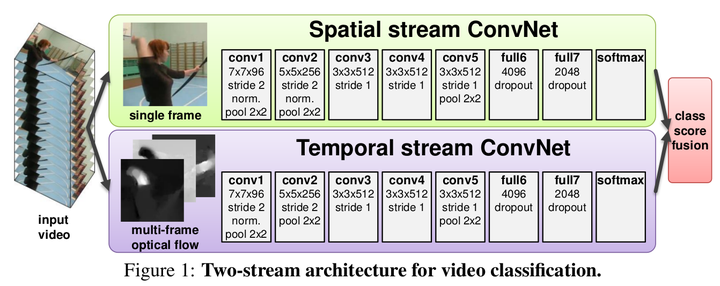

K. Simonyan and A. Zisserman. Two-stream convolutional networks for action recognition in videos. NIPS’14.

采用两个分支。一个分支输入单帧图像,用于提取图像信息,即在做图像分类。另一个分支输入连续 10 帧的光流 (optical flow) 运动场,用于提取帧之间的运动信息。由于一个视频片段中的光流可能会沿某个特别方向位移的支配,所以在训练时光流减去所有光流向量的平均值。两个分支网络结构相同,分别用 softmax 进行预测,最后用直接平均或 SVM 两种方式融合两分支结果。

此外,为了加速训练,Simonyan 和 Zisserman 预先计算出光流并保存到硬盘中。为了减小存储大小,他们将光流缩放到 [0, 255] 后用 JPEG 压缩,这会使 UCF101 的光流数据大小由 1.5TB 减小到 27GB。

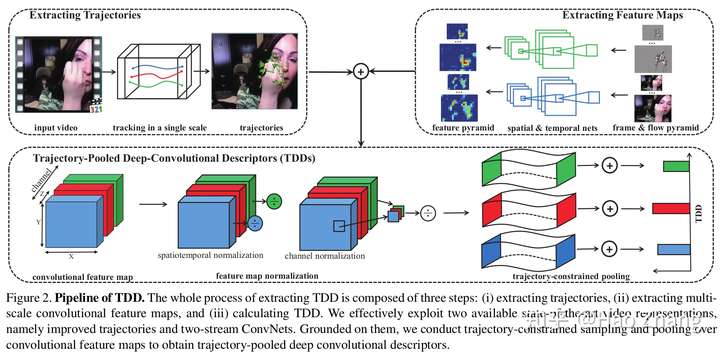

L. Wang, et al. Action recognition with trajectory-pooled deep-convolutional descriptors. CVPR’15.

Wang 等人结合了经典 iDT 手工特征和 two-stream 深度特征,提出 TDD。经典手工特征计算时通常分两步:检测图像中显著和有信息量的区域,并在运动显著的区域提取特征。TDD 将预训练的 two-stream 网络当作固定的特征提取器。得到两者特征之后,TDD 使用时空规范化以保证每个通道的数值范围近似一致,使用通道规范化以保证每个时空位置的描述向量的数值范围近似一致,之后用 trajectory pooling 并用 Fisher 向量构建 TDD 特征,最后用 SVM 分类。

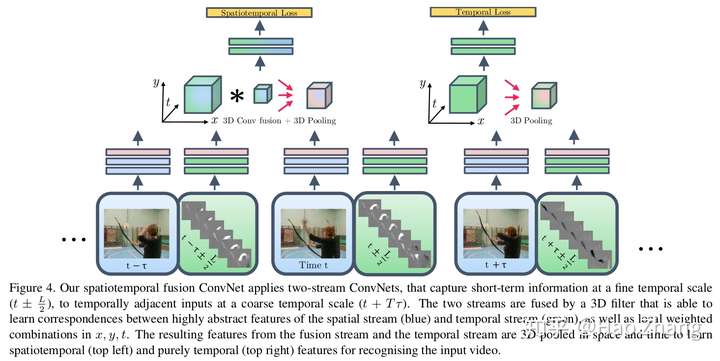

C. Feichtenhofer, et al. Convolutional two-stream network fusion for video action recognition. CVPR’16.

Feichtenhofer 等人研究如何融合两分支的深度卷积特征。他们发现级联两个特征到 2D 维再用 1×1 卷积到 D 维的融合方法效果最好,之后再经过 3D 卷积和 3D 汇合后输出。

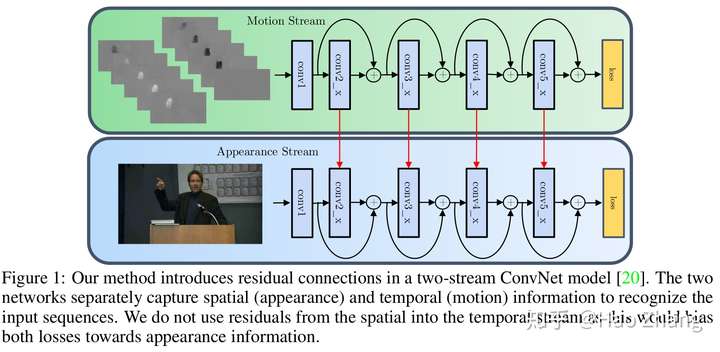

C. Feichtenhofer, et al. Spatio-temporal residual networks for video action recognition. NIPS’16.

Feichtenhofer 将 ResNet 作为 two-stream 的基础网络架构,用预训练网络的权重初始化新的 3D 网络:w (d, t, i, j) = w (d, i, j) / T。此外,有从光流分支到图像分支的信息传递。此外,网络输入不是连续的,而是步长 5 到 15 帧。

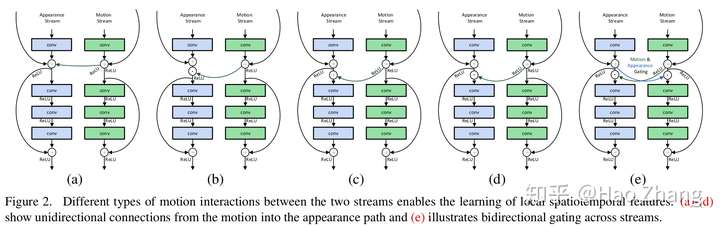

C. Feichtenhofer, et al. Spatio-temporal multiplier networks for video action recognition. CVPR’17.

Feichtenhofer 等人发现,two-stream 网络在外观分支容易过拟合。Feichtenhofer 等人加入了两个分支之间的信息交互,并发现乘性的信息交互效果最好。

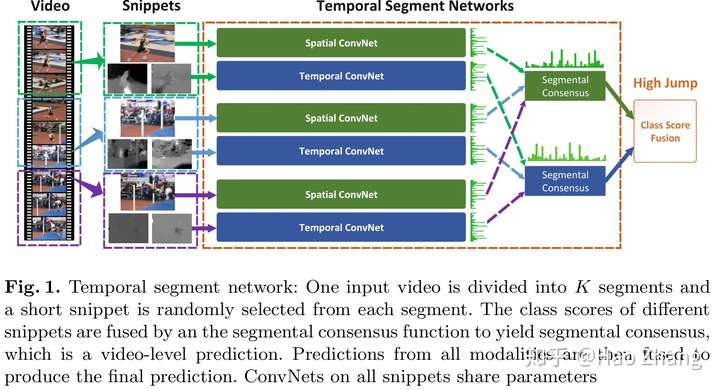

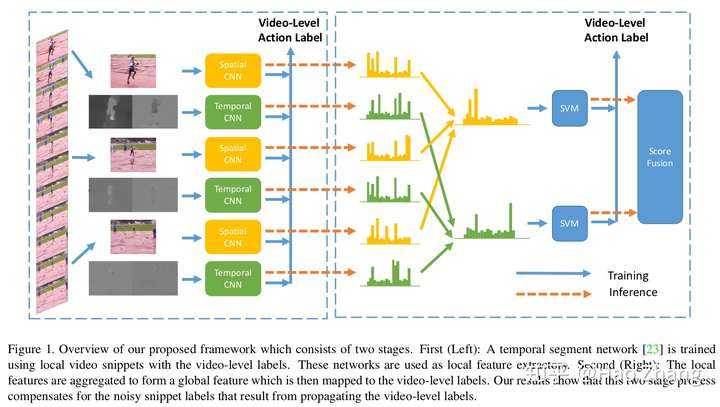

L. Wang, et al. Temporal segment networks: Towards good practices for deep action recognition. ECCV’16.

由于相邻的帧有信息冗余,所以对视频密采样是不需要的。Wang 等人提出 TSN,采用稀疏采样的策略利用整个视频的信息。具体来说,TSN 把视频分成 3 段,每个片段均匀地随机采样一个视频片段,并使用双流网络得到视频片段属于各类得分 (softmax 之前的值),之后把不同片段得分取平均,最后通过 softmax 输出。训练时,TSN 可以根据整个视频的信息而不只是一个视频片段的信息对网络参数进行学习,这是 TSN 最大的优点 (个人认为)。TSN 获得了 ActivityNet 2016 竞赛的冠军 (93.2% mAP)。

此外,除经典的 RGB 图像和光流外,TSN 还尝试了 RGB difference 和 warped 光流。其中,RGB difference 可以认为是对图像运动信息的一个粗略估计,而 warped 光流借鉴经典 iDT 的思路,试图对相机位移作一估计并对光流进行补偿,使得光流代表的运动信息更集中在前景目标上。实验发现,RGB + 光流 + warped optical flow 输入的效果最好。

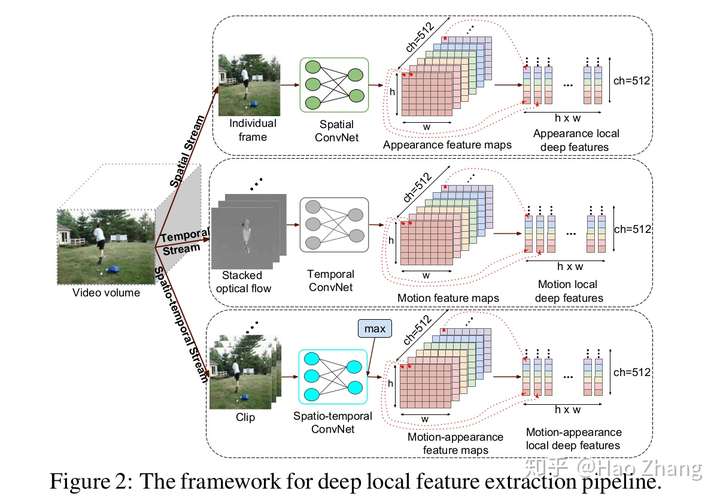

Z. Lan, et al. Deep local video feature for action recognition. CVPR’17.

由于不是视频中每帧都包含有用信息,Lan 等人首先用 TSN 提取局部特征,之后再进行聚合。

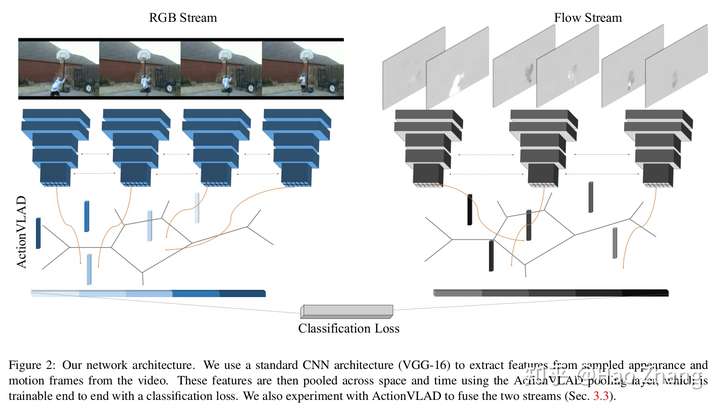

R. Girdhar, et al. ActionVLAD: Learning spatio-temporal aggregation for action recognition. CVPR’17.

类似于 NetVLAD,Girdhar 等人用 two-stream 提取特征,之后用 VLAD 得到视频的表示。实验中发现,图像和光流两个分支单独处理效果最好。

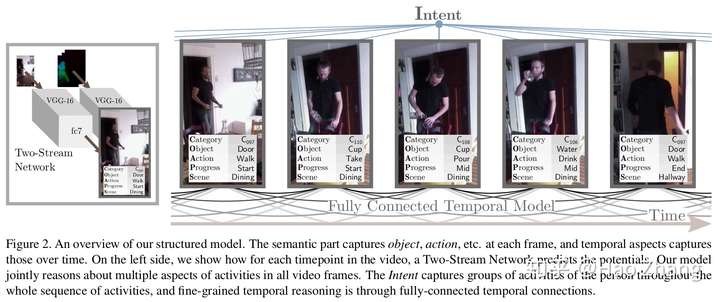

G. A. Sigurdsson, et al. Asynchronous temporal fields for action recognition. CVPR’17.

Sigurdsson 等人利用全连接时序 CRF 对视频的时序关系进行推断。

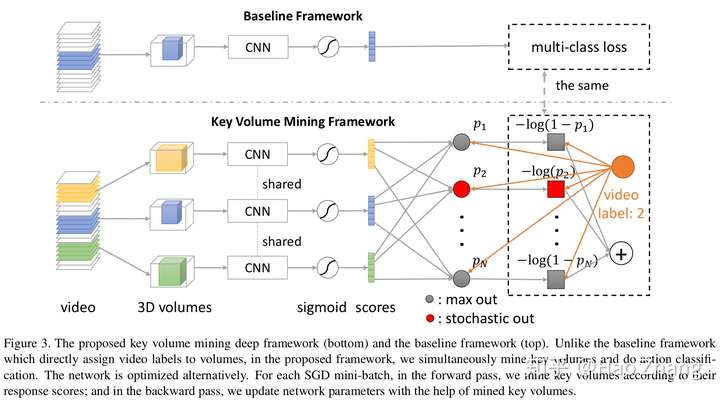

W. Zhu, et al. A key volume mining deep framework for action recognition. CVPR’16.

一段视频中并非所有的帧都对识别任务同等重要,如果把它们同等看待,有价值的帧信息会淹没在其他无关的帧中。借助多示例学习思路,Zhu 等人交替优化关键帧挖掘和分类两个目标。网络输入 N 个视频片段,输出每个片段对应每个类别的分数。如果该类别对应真实标记,采用随机汇合,否则是 maxout 汇合,其中响应最强的视频片段即为得到的关键帧。

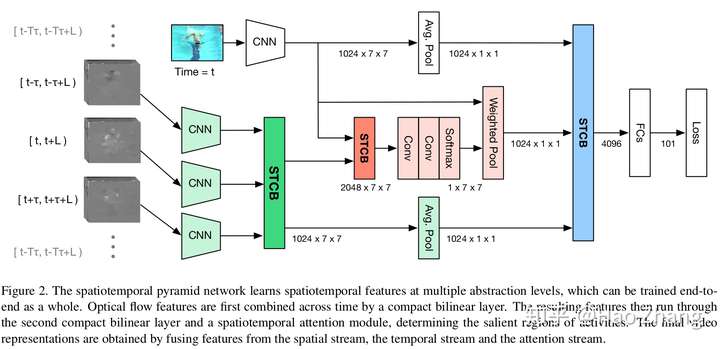

Y. Wang, et al. Spatio-temporal pyramid network for video action recognition. CVPR’16.

Wang 等人利用双线性汇合融合两个分支的特征。

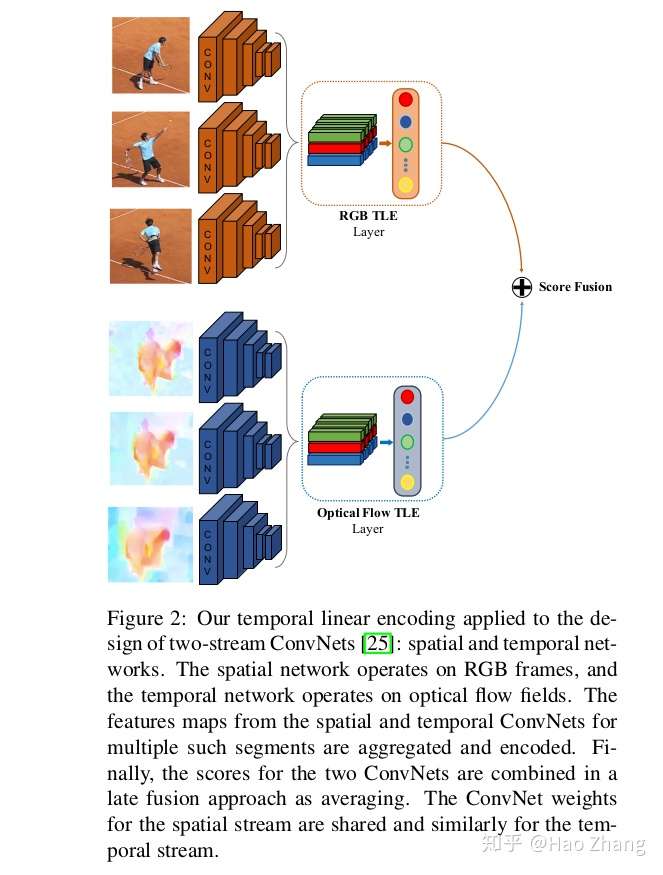

A. Diba, et al. Deep temporal linear encoding networks. CVPR’17.

Diba 等人对不同帧 / 片段的深度卷积特征逐元素相乘,再通过精简双线性汇合得到最终的特征表示。

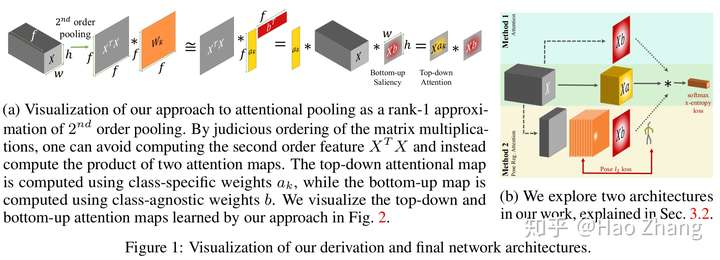

R. Girdhar and D. Ramanan. Attentional pooling for action recognition. NIPS’17.

将双线性汇合用于 TSN 的图像分支。在得到深度卷积特征 之后,经典双线性汇合会计算输入属于第

个类的分数

。Girdhar 和 Ramanan 对参数矩阵

做了一个秩 - 1 近似

实验中, Girdhar 和 Ramanan 将 224 大小的 HMDB-51 缩放到 450 大小,以确保最后的深度卷积特征大小不会太小 (14×14)。当特征大小太小时,效果不显著。另一方面,Girdhar 和 Ramanan 只用了图像分支来处理视频,总体性能和 state-of-the-art 还有很大差距。

I. C. Duta, et al. Spatio-temporal vector of locally max-pooled features for action recognition in videos. CVPR’17.

Duta 等人研究如何聚合不同特征。

C.-Y. Wu, et al. Compressed video action recognition. CVPR’18.

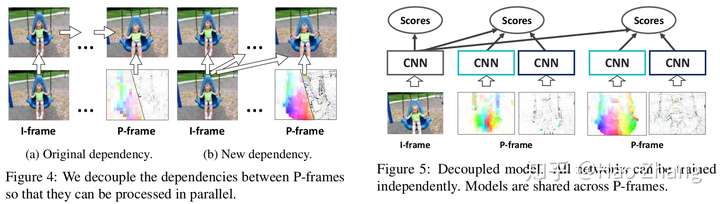

Wu 等人发现:(1). 视频中有很多的冗余信息,这会网络难以提取有用的特征。(2). 相比只利用 RGB 信息,使用光流总是能提升性能。相比之前工作将视频解码为 RGB 图像帧,如果直接输入压缩视频 (如 MPEG,H.264 等),可以 “免费” 地利用这些编码格式中得到的运动信息。视频在压缩时会把帧分为 I 帧 (保存原始图像) 和 P 帧 (保存和参考帧之间的相对运动信息和残差,参考帧可能是 I 帧也可能是 P 帧)。I 帧可以直接用深度神经网络架构进行处理,而如何对 P 帧信息进行处理是这类方法的难点所在。

Wu 等人通过将运动向量追溯到 I 帧来去除 P 帧对 P 帧的依赖,之后对 I 帧、P 帧的运动信息和残差分别前馈网络。在特征融合部分,Wu 等人发现直接相加效果最好。实际中,为降低计算开销,Wu 等人使用一个大网络 (preResNet-152) 处理 I 帧,用一个小网络 (preResNet-18) 处理 P 帧。

P. Weinzaepfel, et al. DeepFlow: Large displacement optical flow with deep matching. ICCV’13.

A. Dosovitskiy, et al. FlowNet: Learning optical flow with convolutional networks. ICCV’15.

E. Ilg, et al. FlowNet 2.0: Evolution of optical flow estimation with deep networks. CVPR’17.

由于经典光流算法很慢,因此有工作致力于使用深度神经网络计算光流。DeepFlow 在不同粒度上进行聚合和匹配,FlowNet 基于类似于视觉跟踪的思路使用互相关滤波综合两张图的深度特征最终生成光流。由于标记数据不足,FlowNet 使用人工合成 Chairs 数据集进行训练。FlowNet 2.0 的贡献有三点。(1). 发现如何进行训练对结果影响至关重要,先在简单的 Chairs 数据集上训练、再在更真实的 Things3D 上训练会比混合两个数据集一起训练效果更好。(2). 多个子网络堆叠,并用中间光流结果对图像进行扭曲输入中间子网络。(3). 有一个子网络专注于微小运动。

<3> 其他视频理解任务

时序动作定位 (temporal action localization) 在一段未剪辑的视频中找到动作开始和结束的时间,并对动作进行分类。

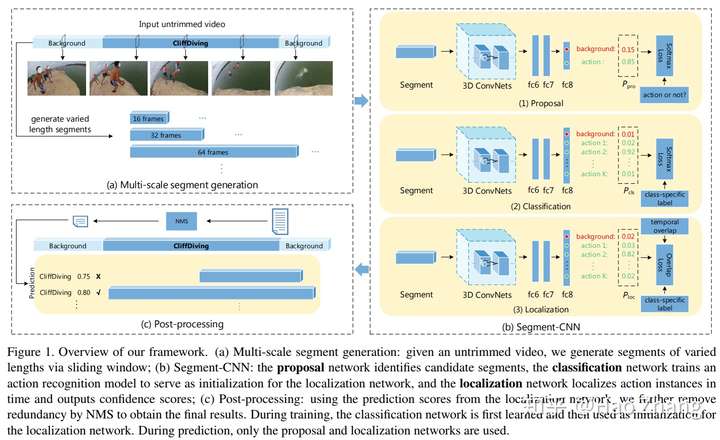

Z. Shou, et al. Temporal action localization in untrimmed videos via multi-stage CNNs. CVPR’16.

Shou 等人提出 SCNN,用不同大小的滑动窗产生视频片段,之后用 3D 候选区域网络判断该视频片段是前景 / 背景,用 3D 分类网络判断 K+1 个类别的分数 (包括背景),最后用定位网络判断开始 / 结束时间。后处理使用非最大抑制 (NMS)。

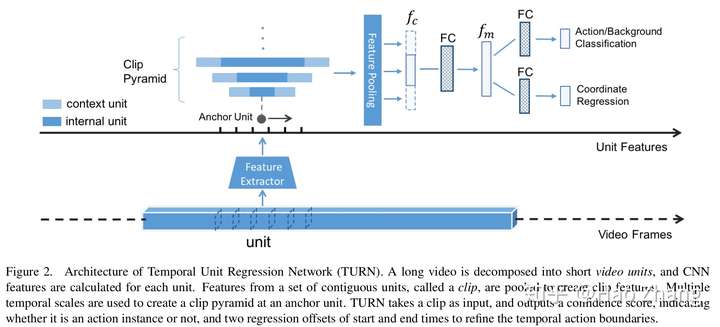

J. Gao, et al. TURN TAP: Temporal unit regression network for temporal action proposals. ICCV’17.

思路类似于 Faster R-CNN。

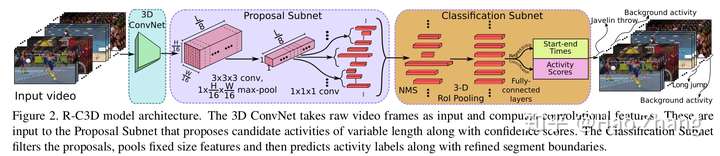

H. Xu, et al. R-C3D: Region convolutional 3D network for temporal activity detection. ICCV’17.

以 C3D 网络为基础,借鉴 Faster R-CNN,对输入视频片段先提取特征,再生成提取候选时序,最后 RoI 汇合后进行检测。

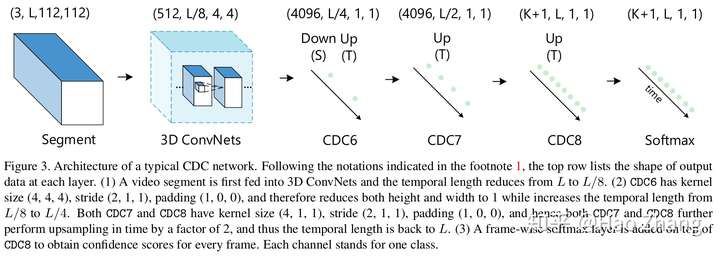

Z. Shou, et al. CDC: Convolutional-de-convolutional networks for precise temporal action localization in untrimmed videos. CVPR’17.

类似于语义分割问题的思路,为了得到对应于每一帧的分类预测分数,Shou 等人在 3D 卷积层之后提出 CDC 卷积,在空间方向用卷积进行下采样,在时间方向上用转置卷积进行上采样。

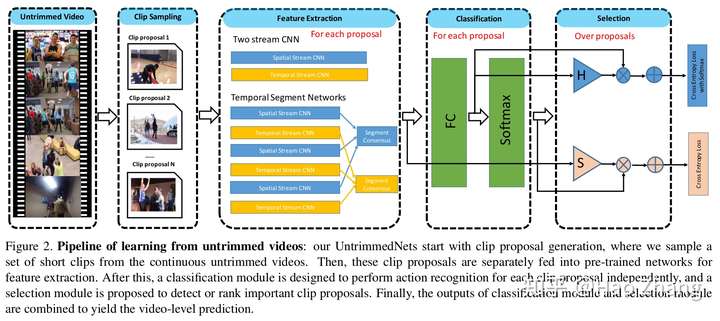

L. Wang, et al. UntrimmedNets for weakly supervised action recognition and detection. CVPR’17.

分类模块用于对每个视频片段进行分类,而选择模块用于给出不同视频片段的重要性。选择模块的实现包括 hard selection 和 soft selection。训练时端到端联合优化。

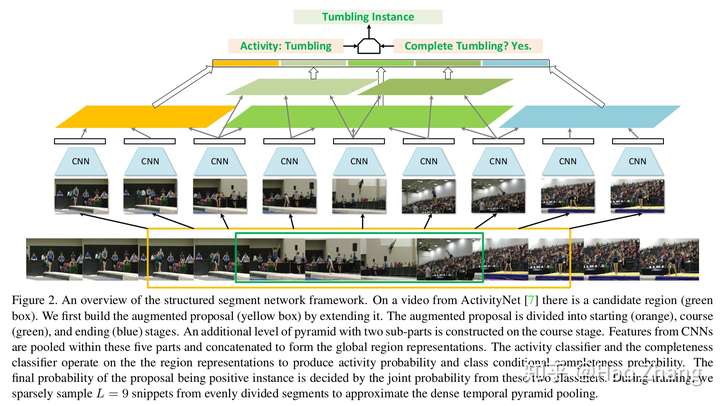

Y. Zhao, et al. Temporal action detection with structured segment networks. ICCV’17.

Zhao 等人提出 SSN,讲视频分为三个部分,最终构成全局特征。分类时有动作性分类器和完整性分类器。

异常检测 (anomaly detection) 通常用于判断监控视频中出现的异常事件。

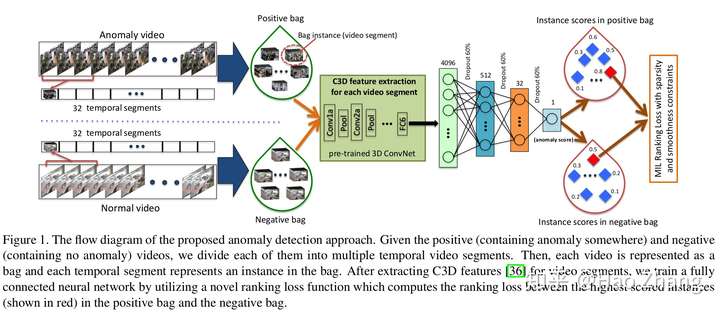

W. Sultani, et al. Real-world anomaly detection in surveillance videos. CVPR’18.

由于训练时只知道一段视频中有 / 没有异常,而异常事件的种类和发生时刻未知,Sultani 等人利用多示例学习,将异常检测问题转化为一个回归排序问题,让异常样本的排序值高于普通样本,训练时让正负样本之间的距离尽可能远。

视频摘要与视频浓缩 (video summarization and video synopsis) 视频摘要是从原始视频中提取有代表性的关键帧,而视频浓缩将多帧视频合并成一帧。

M. Gygli, et al. Creating summaries from user videos. ECCV’14.

X. Li, et al. Surveillance video synopsis via scaling down objects. TIP’16.

"看视频说话"(video captioning) 基本思路和看图说话一致,用编码网络提取视频信息,用解码网络生成文字描述。

S. Venugopalan, et al. Sequence to Sequence–Video to Text. ICCV’15.

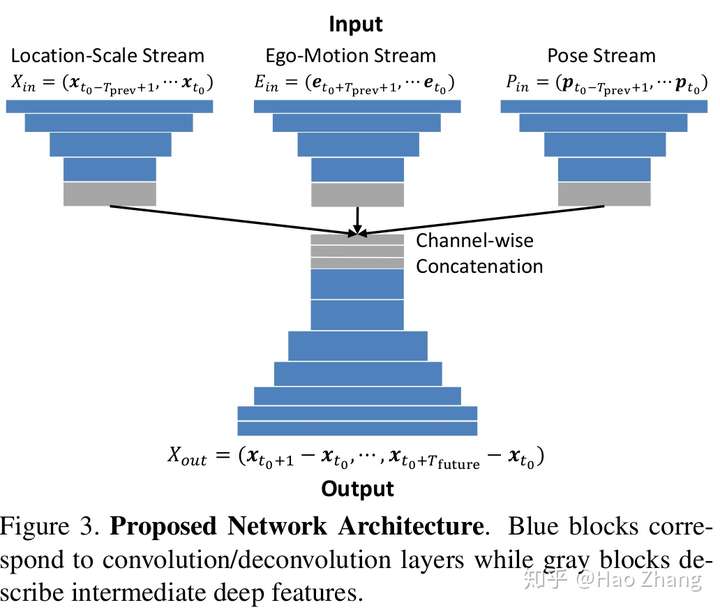

第一视角视频 (first-person video) 研究第一视角视频可以用于自动驾驶、机器人导航等。

T. Yagi, et al. Future person localization in first-person videos. CVPR’18.

Yagi 等人提出行人位置预测任务,即根据行人历史信息,预测下一帧行人的位置。Yagi 等人用 1D 时域卷积来融合不同帧的特征。

视频生成 (next frame generation) 有工作利用生成式模型对视频进行生成。

M. Mathieu, et al. Deep multi-scale video prediction beyond mean square error. ICLR’16.

C. Vondrick, et al. Generating videos with scene dynamics. NIPS’16.

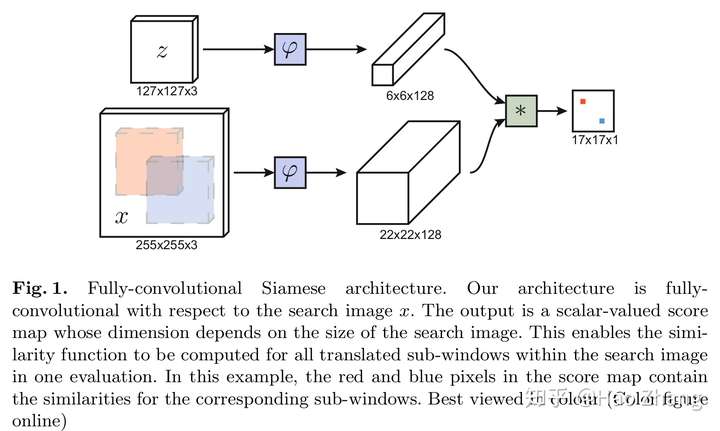

目标跟踪 (object tracking) 给定视频第一帧中目标的位置 (以包围盒的形式),我们需要预测其他帧中该目标的包围盒。目标跟踪类似于目标检测,但目标跟踪的难点在于事先不知道要跟踪的目标具体是什么,因此无法事先收集足够的训练数据以训练一个专门的检测器。一种研究思路是利用孪生网络,一支输入第一帧包围盒内图像,另一支输入其他帧的候选图像区域,通过互相关操作 (卷积),得到二维的响应图,其中最大响应位置确定了需要预测的包围盒位置。

L. Bertinetto, et al. Fully-convolutional siamese networks for object tracking. ECCV’16 Workshop.

M. Danelljan, et al. ECO: Efficient Convolution Operators for tracking. CVPR’17.

E. Valmadre, et al. End-to-end representation learning for correlation filter based tracking. CVPR’17.

<4> 可能的未来方向

- 利用多示例学习进行视频分析。未剪辑视频中有很多无关内容,并非视频中所有的帧都对应于该视频标记,这符号多示例学习的设定。虽然 Zhu 等人在 CVPR’16 和 Kar 等人在 CVPR’17 的工作中对这方面已有一些探索,但仍有后续精进的空间。

- 精度与效率。Two-stream 和 3D 卷积的方法相比,大致来说前者的效果更好,但前者需要逐帧图像前馈网络,而后者一次可以处理多帧,因此前者效率不如后者,尤其是预先计算并保存光流是一个很繁重的负担。如何能同时利用两者的优点是未来一个可能的研究方向,Feichtenhofer 等人在 CVPR’16 已有初步的工作。LSTM 能捕获的长距离依赖程度有限,并且更难训练,速度也更慢,因此 ConvLSTM 的方法在视频分析中用的不多。

- 资源受限下的视频分析。相比图像数据,处理视频数据需要更大的计算和存储资源。现实应用中很多是资源受限的,如何在这种场景下进行视频分析是一大挑战。将视频解压为能输入网络的一帧帧图像也需要不小的资源开销,Wu 等人在 CVPR’18 提出直接利用原始视频输入,并利用视频压缩编码中的运动信息。

- 更大、更通用数据集。哪种方法更好和用什么数据集 (解决什么任务) 有很大关系。如果视频本身就比较静止,或者单帧图像已经包含了足够的信息,那么用逐帧单独处理的策略已经可以取得很好的结果。

- 视频 = 图像 + 音频。视频是一种多模态的数据形式,能否利用音频信息辅助视频分析呢。Aytar 等人在 NIPS’16 的工作中利用图像辅助音频分析。

Y. Aytar, et al. SoundNet: Learning sound representations from unlabeled video. NIPS’16.

最后列出一些相关的综述文章。其中 Tran 等人实验研究了不同采样步长、不同输入大小、不同网络配置等对性能的影响。

Z. Wu, et al. Deep learning for video classification and captioning. arXiv: 1609.06782.

D. Tran, et al. ConvNet architecture search for spatio-temporal feature learning. arXiv: 1708:05038.

M. Asadi-Aghbolaghi, et al. A survey on deep learning based approaches for action and gesture recognition in image sequences. FG’17.

S. Herath, et al. Going deeper into action recognition: A survey. IVC’17.